【オフラインでも使える】PC上に生成AIチャット環境を構築する方法

生成AIを使いたいけど、「インターネット接続なしで安全に使いたい」「社内データを外に出したくない」と感じたことはありませんか? この記事では、PC上に生成AIのチャット環境を構築する方法を、できるだけシンプルに解説します。 Dockerを使ってサクッと立ち上げ、ChatGPTライクなUIまで用意できます。

なぜPC上なのか?

PC上で生成AIを使うことで以下のような課題を解決できます。

- 社内機密データをクラウドに送信したくない

- オフライン環境でも生成AIを使いたい

- APIコストを気にせず使いたい

- カスタム用途(社内ツール連携など)に活用したい

前提条件

この記事ではCPUで動作するPCを想定しています。 最低限、以下のスペックがあると快適です。

- メモリ:16GB以上(推奨)

- Dockerが動作する環境

サーバーの選択肢

LLMを動かすための代表的なサーバーを紹介します。

Ollama

- シンプルで扱いやすい

- モデルのダウンロード・起動が簡単

- REST APIが標準で使える

👉 初心者〜中級者におすすめ

llama.cpp

- 軽量で高速(C++実装)

- 細かいチューニングが可能

- CLI中心でやや上級者向け

👉 パフォーマンス重視・エンジニア向け

LLMの選択肢

代表的なモデル群です。

-

Gemma(Google製)

- 軽量で動かしやすい(ローカル向き)

- 応答が安定していてクセが少ない

- 日本語もそこそこ対応

-

Qwen(Alibaba製)

- 多言語性能が高い(特にアジア言語に強い)

- コーディング・論理系タスクが得意

- モデルサイズのバリエーションが豊富

-

Llama(Meta製)

- オープンLLMの代表格で情報量が豊富

- 派生モデル・コミュニティが非常に活発

- チューニングや拡張の自由度が高い

それぞれ特徴がありますが、今回は軽量で扱いやすいGemmaを使います。

今回の構成

シンプルに以下の構成で構築します。

- サーバー:

Ollama - モデル:

gemma3:1b - UI:

Open WebUI

セットアップ手順

1. LLMサーバー(Ollama)のセットアップ

まずはDockerでOllamaを起動します。

docker-compose.yml

services: ollama: image: ollama/ollama:latest container_name: ollama ports: - "11434:11434" volumes: - ./ollama:/root/.ollama

起動

docker compose up -d

モデルの起動

docker exec -it ollama ollama run gemma3:1b

初回はモデルのダウンロードが走ります(数GB程度)。

動作確認(APIテスト)

curl http://localhost:11434/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{"model": "gemma3:1b", "messages": [ {"role": "system", "content": "あなたは優秀なアシスタントです。"}, {"role": "user", "content": "こんにちは。"} ] }'

レスポンス例

{ "id": "chatcmpl-693", "object": "chat.completion", "created": 1776497078, "model": "gemma3:1b", "choices": [ { "message": { "role": "assistant", "content": "こんにちは!何かお手伝いできることはありますか? 😊" } } ] }

👉 ここまでで「APIとしての生成AI」は完成です。

2. チャットUIのセットアップ

次に、ブラウザから使えるUIを追加します。

今回は Open WebUI を使います。

GitHub: https://github.com/open-webui/open-webui

docker-compose.yml に追記

open-webui: build: context: . dockerfile: Dockerfile image: ghcr.io/open-webui/open-webui:main container_name: open-webui volumes: - open-webui:/app/backend/data depends_on: - ollama ports: - 8080:8080 environment: - 'OLLAMA_BASE_URL=http://ollama:11434' - 'WEBUI_SECRET_KEY=change_me_with_your_secret_key' extra_hosts: - host.docker.internal:host-gateway restart: unless-stopped volumes: open-webui: {}

起動

docker compose up -d

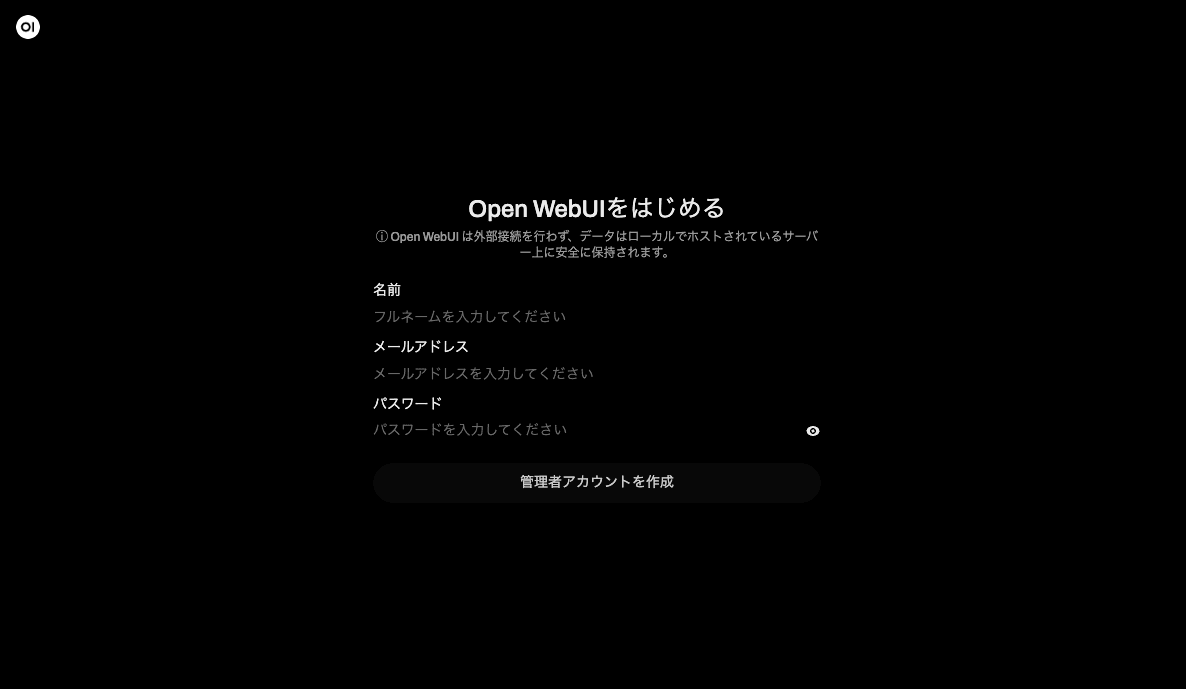

初期セットアップ

ブラウザで以下にアクセス:

http://localhost:8080

-

管理者アカウントを登録

- 適当な名前とメールアドレスとパスワードを設定してください。

-

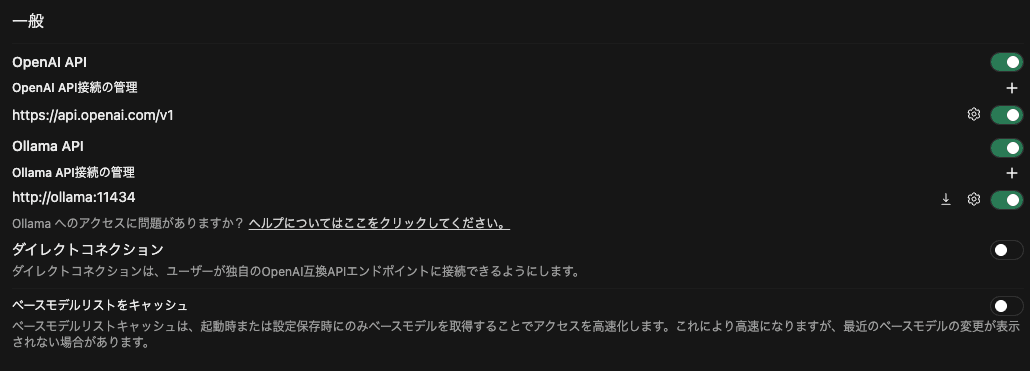

Ollamaとの接続を確認

- 管理者パネル > 設定 > 接続を表示。

- Ollama API接続の管理が

http://ollama:11434となっていればOK

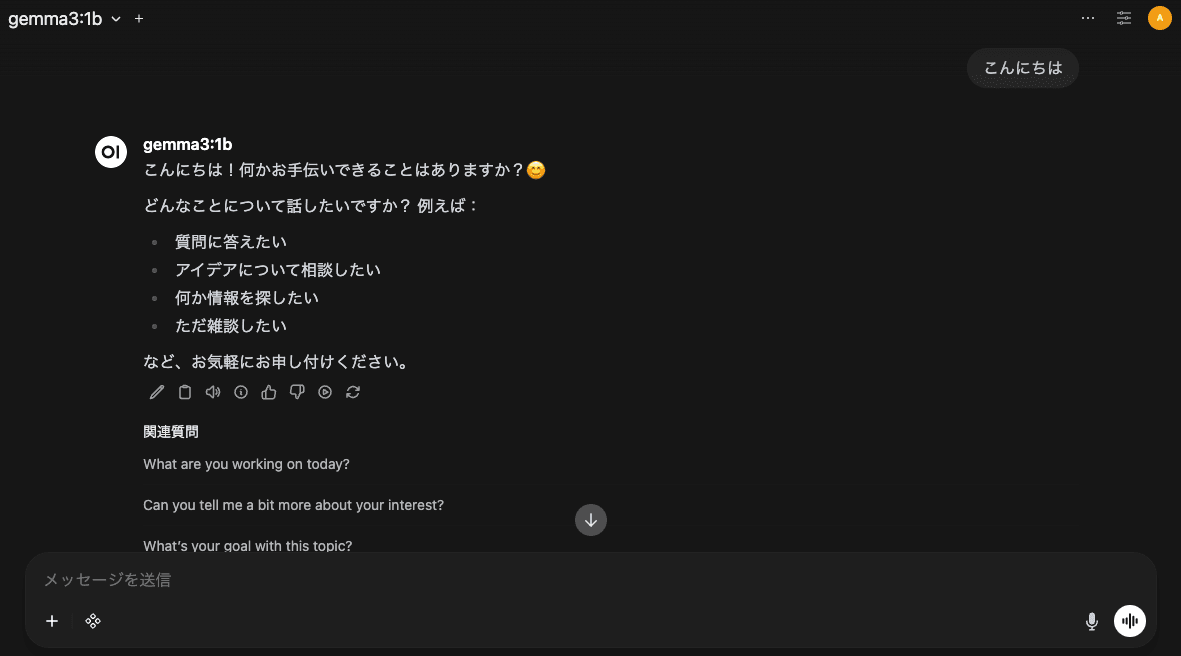

チャットを試す

これで完成です。

- 完全ローカル環境

- 外部通信なし

- ChatGPTライクなUI

👉 社内専用のAIチャット環境としてそのまま使えます。

この構成でできること

- 社内ドキュメントの要約・検索

- 翻訳

- コード生成・レビュー

- オフラインAIアシスタント

- アイデアの壁打ち

など

まとめ

PCでの生成AI環境は、思っているより簡単に構築できます。

今回のポイント:

- Ollamaで簡単にLLMを起動

- Gemmaで軽量&高性能

- Open WebUIで使いやすいUIを実現

「まずは触ってみる」には最適な構成です。

参考

この記事をシェアする

合同会社raisexでは一緒に働く仲間を募集中です。

ご興味のある方は以下の採用情報をご確認ください。